- GoogleのAI検索は便利ですが、Googleじしんが「AIの回答にはミスがあり得る」と案内しています。

- 今回みたいな「本物・ニセモノ・現在の活動状況」みたいな固有名詞案件は、AI要約を最終回答にすると事故りやすいです。

- 対策はシンプルで、一次情報・日付・出典・別ソースの4点確認です。これだけで被弾率はかなり下がります。

はじめに

検索して上のほうにAIの回答が出ると、「おっ、もう答え出てるじゃんw」と思いがちです。ですが、そこに書いてある文章が、いつも正しいとは限りません。GoogleはAI Overviewsを「複数の情報源をすばやく理解する助け」と説明する一方で、AIの回答にはミスがあり得るとも明記しています。つまり、便利な入口ではあっても、ゴール扱いすると危ないわけです。今回のような「ニセモノ注意」「本人の現状」みたいな話ほど、その差がモロに出ます。

なぜGoogleのAI検索結果は「もっともらしくズレる」のか!?

まず大前提として、AI検索は「リンクの一覧」そのものではなく、「複数の情報を要約して返す仕組み」です。Googleも、AI Overviewsは複数ソースの理解を助けるための機能だと説明しています。ところが、要約は便利なぶん、元ソースの温度差や不確実さを丸めてしまいます。弱い情報と強い情報、推測と確認済み情報が、同じ太さの文章で並んでしまうのです。だからこそ、見た目は整っていても、中身はズレることがあります。

さらにGoogleは、生成AIについて「mistakes を含み得る」「作り話をすることがある」「誤解することがある」と案内し、事実として受け取る情報はGoogleやそのほかの資料で確かめてほしいとしています。ここはかなり重要です。つまりGoogleじしんが、「AI回答は便利だが、そのまま確定情報として飲み込むな」と言っているわけです。

実際、AI検索まわりでは「ありそうな話」を自信満々にまとめてしまう問題が外部でも指摘されています。たとえば、Harvard Kennedy Schoolの論考では、GoogleのAI Overviewが風刺ネタを事実として扱った例が取り上げられています。見た目が自然だと、読み手はつい警戒を下げます。そこがいちばん怖いところですw

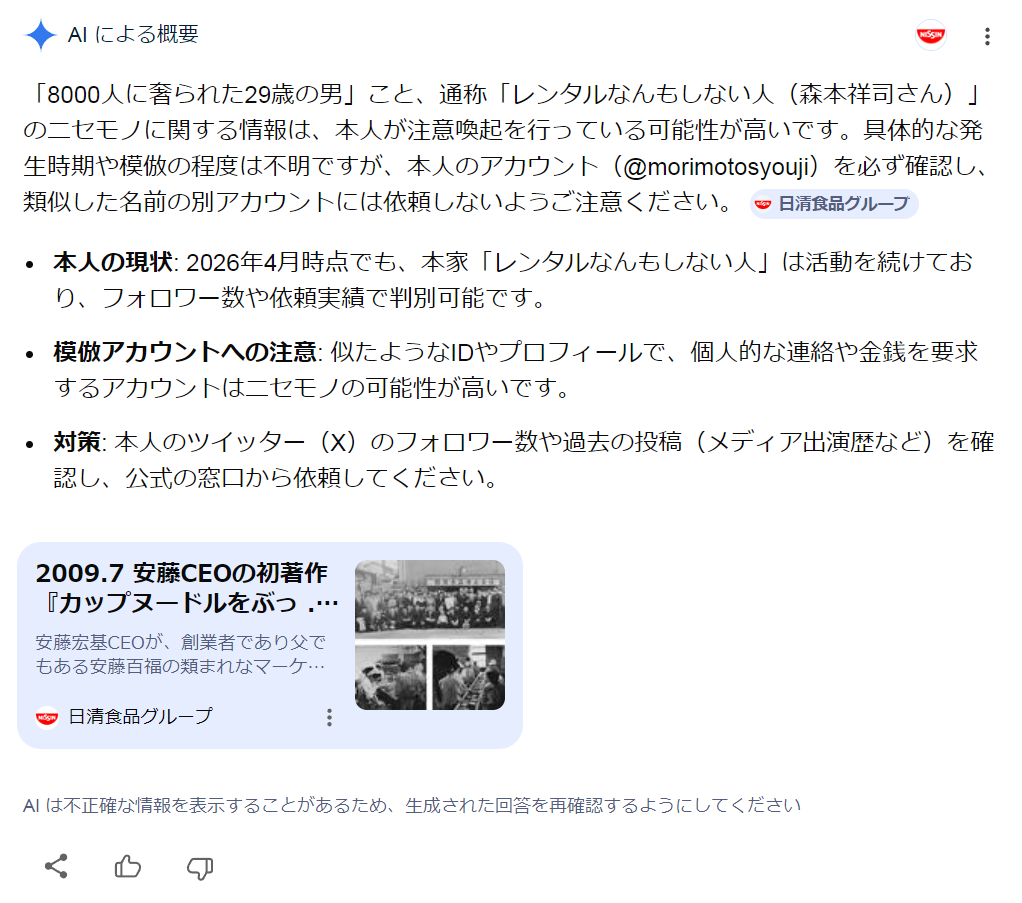

今回の検索結果、どこが危ないのか!?w

今回の文面のヤバい点は、「断定」と「推測」が同居しているところです。たとえば「本人が注意喚起を行っている可能性が高いです」と書いてある時点で、そこは確認済みではなく、かなり怪しいです。にもかかわらず、その直後に「現状」「判別方法」「依頼時の注意」までスラスラ続くと、読み手は全部セットで真実っぽく受け取ってしまいます。これ、AI要約でよくある事故パターンです。

しかも「フォロワー数や依頼実績で判別可能です」みたいな記述は、いかにも役立ちそうですが、時間とともに変わる情報です。こういう“変動する指標”は、今この瞬間の確認が必要です。Google公式も、日付は重要で、変化の速い話題では古い情報が役に立たないことがあると案内しています。逆に言えば、日付が曖昧なAI要約をそのまま信じるのは危険です。

要するに、今回のような文面は「半分ほんとう、半分あやしい」が最悪の形で混ざるタイプです。全部ウソならまだ警戒できます。ですが、実在する名前・知られた活動・もっともらしい注意文が並ぶと、脳が勝手に「たぶん合ってる」と補完してしまいます。フェイク情報が強いのは、完全なデタラメだからではなく、一部の事実に寄りかかって全体を信用させるからです。

フェイク情報で事故らない!!! いますぐ使える「5つの確認」

1.AI要約の文章を「完成品」ではなく「下書き」と見ることです

- AI要約は答えではなく、確認の出発点だと思うのが安全です。

AIが上で要約してくれるとラクですが、その便利さと正確さは別問題です。最初の1分で全体像をつかむ用途には向いていますが、「本物か」「現在どうなのか」「詐称があるのか」みたいな確認には、そのまま使わないほうがいいです。GoogleもAI回答の誤り可能性を明示しています。

2.固有名詞の話は、まず公式導線に飛ぶことです

- 名前、公式サイト、公式SNS、運営窓口の順で確認します。

「誰の話か」「どのアカウントか」「どこから依頼するのか」は、一次情報が最強です。AI要約に書いてあるアカウント名をそのまま信じるのではなく、公式サイト、認証済み導線、著書や出演歴からつながる公式SNSなど、当の発信元から逆引きするのが鉄則です。とくにニセモノ案件は、このひと手間でかなり防げます。

3.日付を見ることですw 昨日の話か、3年前の話かで意味が変わります

- 変化の速い話題ほど、日付確認は最優先です。

Googleのヘルプでも、古い情報は変化の速い話題では役に立たない場合があるとされています。活動状況、フォロワー数、なりすまし注意、窓口変更などは、まさにその典型です。「2026年4月時点」と書いてあっても、その根拠リンクが見当たらないなら、一旦止まるべきです。日付のある一次情報へ飛べるかどうかで、信頼度は大きく変わります。

4.「ほかのソースは何と言っているか」を必ず見ることです

- ひとつの要約より、複数ソースの一致を見ます。

Googleは、検索で見つけた情報を評価する方法として、「About this result」「News」「Google NewsのFull Coverage」「Fact Check Explorer」などを案内しています。つまりGoogleじしんも、ひとつの見え方だけで判断せず、周辺情報を見ろと言っているわけです。噂っぽい話は、検索結果の通常タブだけで終わらせず、ニュース面やファクトチェック面まで見たほうがいいです。

5.「言い切っているのに出典が薄い文」を最も疑うことです!!!

- 自信満々の文ほど、根拠リンクの太さを見ます。

フェイクっぽい文の特徴は、文章がスムーズすぎることです。「注意喚起している可能性が高いです」「依頼しないようご注意ください」「公式窓口から依頼してください」みたいに、読者が納得しやすい流れで並ぶと、つい受け入れてしまいます。ですが、本当に大事なのは、その文の裏にどの出典がぶら下がっているかです。出典が薄い、古い、無関係、あるいは見当たらないなら、そこで信用を止めるべきです。

じゃあ、GoogleのAI検索結果は信用ゼロなのか??

ゼロではないです。 ここは極端に考えないほうがいいです。GoogleはAI Overviewsを、幅広い情報をすばやく把握する助けとして提供していますし、関連リンクも出します。ざっくり理解、比較の入口、用語の整理にはかなり便利です。実際、Googleはこの機能を広く展開していて、すでに多くの国・言語で利用できる状態です。

ただし、「便利」と「最終確認に使える」は別です。とくに、なりすまし、詐欺、健康、法律、お金、いま現在の活動状況みたいな話は、AI要約をうのみにするほど危ないです。外部でも、医療系の誤情報や低品質ソース混入への懸念が指摘されています。読みやすいから安全、ではありません。むしろ読みやすすぎる時ほど、ちょっと引いて見るくらいでちょうどいいです。

質疑応答コーナー!!!

GoogleのAI検索って、上に出たら信用していいってことっすか??

それは違います。上に出るのは「便利だから」であって、「100%正しいから」ではないです。Googleじしんが、AIの回答にはミスがあり得ると案内しています。まずは便利な要約として受け取り、固有名詞や現在情報は一次情報で詰めるのが安全です。

今回みたいな「本物かニセモノか」は、どこを見ればいいんすか??

公式導線です。公式サイト、公式SNS、運営窓口、日付つき告知、この順で見ます。さらに別ソースでも同じ内容が確認できるかを見ると強いです。AI要約の文面より、「その内容を誰がいつ出したか」を優先してください。

まず何を確認すれば事故りません??

まずは出典・日付・公式導線の3点です。この3つが弱いなら、その情報は保留でいいです。急いで結論を出すより、「まだ確定していない」と止まれるほうが、ネットでは強いです。Googleも複数ソースやファクトチェック機能の活用を案内しています。

まとめ

- GoogleのAI検索は便利ですが、Googleじしんが「誤ることがある」と明言しています。だから鵜呑みは危険です。

- 本物・ニセモノ・現在の活動状況みたいな話は、AI要約ではなく一次情報で確認するべきです。

- 迷ったら「出典」「日付」「公式導線」「別ソース一致」の4点確認です。これだけでだいぶ事故らなくなりますw